TL;DR

Suchmaschinen und Suche 2026 kurz erklärt

Definition: Suchmaschinen sind digitale Index-Systeme zur Informationsbeschaffung. Man unterscheidet zwischen klassischen Websuchmaschinen wie Google und Bing, diskreten Suchmaschinen wie DuckDuckGo und Startpage sowie Answer Engines wie Perplexity und ChatGPT Search.

💡Die Suche 2026 wird von KI-Antworten, Nutzerkontext und Plattformen bestimmt. Wer sichtbar sein will, muss Inhalte liefern, die direkt beantwortbar, klar strukturiert und zitierfähig sind.

Autor: Wolf-Reinhart Kotzsch

SEO seit 2007 – Erfahrung aus Agenturen und eigenen Projekten. Schwerpunkt heute: KI-Suche, AEO und Sichtbarkeit in generativen Suchsystemen.

Erst kurz in die Zusammenfassung reinhören?

Zentrale Fakten 2026:

-

Marktführer: Google hält ca. 90-93 % Mobil-Marktanteil in Deutschland; Bing wächst am Desktop (ca. 8-12 %) durch Copilot- und Systemintegration.

-

KI-Transformation: Die Suche erweitert sich von der Linkliste hin zu Zero-Click-Antworten, die durch Large Language Models (LLMs) ergänzt werden.

-

Ranking-Faktor: Sichtbarkeit in KI-Antworten erfordert GEO (Generative Engine Optimization) durch klare Struktur, direkte Antworten und hohe inhaltliche Qualität; strukturierte Daten unterstützen.

-

Datenschutz: Diskrete Suchmaschinen reduzieren Personalisierung durch Anonymisierung der IP-Adresse und Verzicht auf Nutzertracking, verhindern Filterblasen jedoch nicht vollständig.

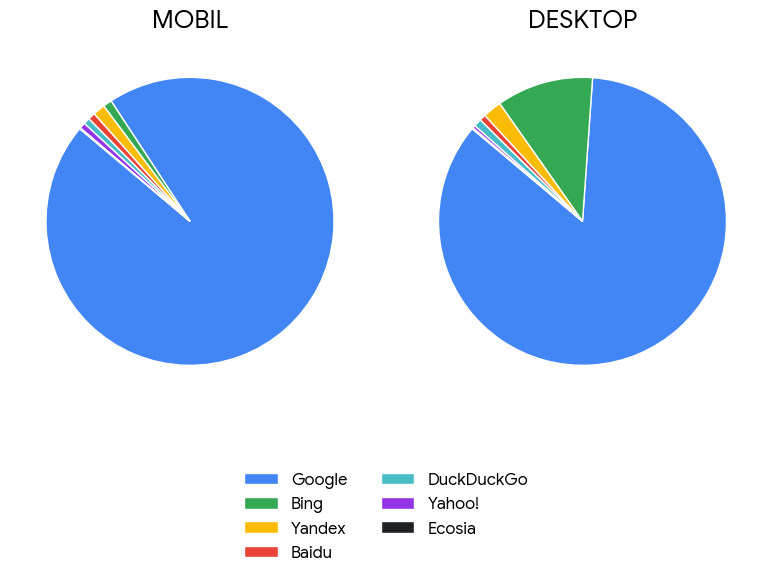

Marktanteile der bekanntesten Suchmaschinen (März 2026)

1. Globaler Vergleich

Der Suchmaschinenmarkt zeigt 2026 eine starke Fragmentierung zwischen Desktop- und Mobile-Nutzung.

| Suchmaschine | Desktop % (Feb 2026) | Mobil % (Feb 2026) |

|---|---|---|

| 82,94 % | 95,17 % | |

| Bing | 10,75 % | 0,70 % |

| Yahoo! | 2,62 % | 0,54 % |

| YANDEX | 1,62 % | 1,15 % |

| DuckDuckGo | 0,81 % | 0,72 % |

| Baidu | 0,31 % | 0,73 % |

Quelle: StatCounter Global Stats, weltweit, Februar 2026 (Search Engine Market Share nach Gerät).

2. Vergleich in Deutschland

In Deutschland ist die Desktop-Konkurrenz durch Microsoft Bing (18,0 %) deutlich ausgeprägter als im globalen Durchschnitt. Google behauptet seine mobile Vormachtstellung (91,4 %) primär durch die tiefe Integration in Android- und iOS-Systeme.

| Suchmaschine | Desktop % (Jan 2026) | Mobil % (Jan 2026) |

|---|---|---|

| 71,2 % | 91,4 % | |

| Bing | 18,0 % | 1,0 % |

| Yahoo! | 4,6 % | 0,35 % |

| DuckDuckGo | 2,3 % | 1,6 % |

| YANDEX | 1,8 % | 3,4 % |

| Ecosia | 1,4 % | 2,0 % |

Quelle: StatCounter, Deutschland, Januar 2026 (Suchmaschinen-Marktanteile nach Gerät).

3. Suchmaschinen-Trends 2026

Die Evolution der Suche wird durch drei Kernfaktoren bestimmt:

- Google-Erosion am Desktop: Google verliert Desktop-Anteile an KI-getriebene Wettbewerber.

- Bing-Wachstum: Durch die Copilot-Integration in Windows und Edge etabliert sich Bing als Standard für produktive Informationssuche.

- Regionale Spezialisierung: Yandex (Russland) und Baidu (China) halten stabile Anteile in ihren Kernmärkten (ca. 2 % global), verlieren jedoch durch lokale Konkurrenz von Social-Content-Plattformen an globaler Dynamik.

Klassifizierung und Vergleich der Suchsysteme

Moderne Informationssysteme lassen sich 2026 in fünf Kategorien unterteilen:

- Klassische Websuchmaschinen: Indexbasierte Crawler-Systeme (Google, Bing).

- Metasuchmaschinen: Aggregatoren ohne eigenen Index (Startpage, MetaGer).

- Vertikale Suchmaschinen: Spezialsuche für Fachgebiete (YouTube, Amazon, Google Scholar).

- KI-Suchmaschinen (Answer Engines): Generative Systeme, die Synthesen statt Linklisten liefern (Perplexity, ChatGPT Search).

- Semantische Suchmaschinen: Kontextbasierte Wissensdatenbanken (Wolfram Alpha).

Im Jahr 2026 hat sich die digitale Suche in fünf technologische Hauptkategorien diversifiziert. Während klassische Websuchmaschinen wie Google weiterhin auf riesigen Crawler-Indizes basieren, gewinnen Answer Engines (z. B. Perplexity) durch generative KI-Synthese massiv an Bedeutung.

Metasuchmaschinen wie Startpage fungieren primär als Datenschutz-Layer ohne eigenen Index, während vertikale Suchmaschinen (wie Amazon oder YouTube) die spezialisierte Fachsuche dominieren. Ergänzt wird dieses Ökosystem durch semantische Suchsysteme wie Wolfram Alpha, die Antworten auf Basis logischer Wissensdatenbanken statt reiner Textmuster generieren.

| Suchmaschinentyp | Funktionsweise | Typische Merkmale | Beispiele |

|---|---|---|---|

| Klassische Websuchmaschinen | Durchsuchen das Web mit Crawlern, indexieren Inhalte und zeigen Suchergebnisse als Linklisten an. | Eigener Index, Ranking-Algorithmen, klassische SERPs mit organischen Treffern und Anzeigen. | Google, Bing, DuckDuckGo, Yahoo |

| Metasuchmaschinen | Greifen auf mehrere externe Suchmaschinen zu und bündeln deren Ergebnisse. | Kein eigener Vollindex, Ergebnisaggregation, oft datenschutzorientiert. | Startpage, MetaGer, Dogpile |

| Vertikale Suchmaschinen | Durchsuchen spezialisierte Datenbanken oder Plattformen zu einem bestimmten Themenfeld. | Fachspezifische Suche, hohe Relevanz innerhalb eines Segments, eigene Filterlogiken. | YouTube, Amazon, Google Scholar, Indeed |

| KI-Suchmaschinen / Answer Engines | Kombinieren Suche, Quellenanalyse und generative KI, um direkte Antworten auf Fragen zu erstellen. | Antworten statt reiner Linklisten, Zusammenfassungen, häufig mit Quellenangaben. | Perplexity, Microsoft Copilot, Google AI Overviews |

| Semantische Suchmaschinen | Versuchen, die Bedeutung und den Kontext einer Suchanfrage zu verstehen, statt nur Keywords abzugleichen. | Kontextverstehen, strukturierte Daten, Knowledge Graphs, stärker bedeutungsorientierte Suche. | Wolfram Alpha |

Hinweis: Auf kleineren Bildschirmen ist die Tabelle horizontal scrollbar, damit alle Inhalte lesbar und nutzbar bleiben.

Google - Die beliebteste Suchmaschine weltweit

Entstehung und Vision

Die Geschichte von Google begann 1996 als Forschungsprojekt namens „BackRub“ an der Stanford University. Die Gründer Larry Page und Sergey Brin verfolgten das Ziel, die Relevanz von Webseiten mathematisch messbar zu machen. 1998 folgte die offizielle Gründung der Google Inc.Namensherkunft: Der Name leitet sich von „Googol“ ($10^{100}$) ab und symbolisiert die Mission, die gigantischen Informationsmengen des digitalen Zeitalters zu organisieren.

Der technologische Vorsprung (PageRank)

Bevor Google den Markt dominierte, basierten Suchmaschinen wie AltaVista, Lycos oder Yahoo! auf einfachen Stichwortabgleichen oder manuellen Verzeichnissen. Googles entscheidender Vorteil war die Einführung des PageRank-Algorithmus:

- Link-Autorität: Webseiten wurden erstmals basierend auf der Qualität und Quantität ihrer Verlinkungen bewertet.

- User Experience: Eine minimalistische Startseite und extrem kurze Ladezeiten setzten neue Standards.

- Präzision: Die Ergebnisse waren deutlich schwerer zu manipulieren und boten eine höhere Informationsqualität.

Aufstieg zum digitalen Ökosystem

Heute operiert Google unter dem Dach der Holding Alphabet Inc. Der wirtschaftliche Erfolg stützt sich primär auf personalisierte Online-Werbung (Google Ads). Über die Suche hinaus hat Google das Internet durch ein integriertes Ökosystem geprägt:

- Infrastruktur: Gmail und Google Maps.

- Content: YouTube (die zweitgrößte Suchmaschine der Welt).

- Mobile: Das Betriebssystem Android.

Datenschutz und Herausforderungen

Als Marktführer steht Google kontinuierlich im Fokus der Datenschutzdebatten, insbesondere innerhalb der Europäischen Union (DSGVO). Die Erhebung umfangreicher Nutzerdaten - von Suchverläufen bis hin zu Standortprofilen - dient der Personalisierung von Diensten, führt jedoch zu Kritik an der monopolistischen Datenhoheit des Konzerns.

Bing - Die KI-getriebene Alternative von Microsoft

Microsoft Bing (eingeführt 2009 als Nachfolger von Live Search) hat sich als zweitstärkste Kraft im Suchmaschinenmarkt etabliert. Während Google global dominiert, ist Bing besonders am Desktop und im Enterprise-Sektor (B2B) unverzichtbar geworden.

Strategische Vorteile und Integration

Browser-Synergie: Als Standard-Suchmaschine im Microsoft Edge Browser profitiert Bing von der nahtlosen Systemintegration in Windows 11 und Windows 12.

KI-Pionier mit Copilot: Durch die frühe Allianz mit OpenAI transformierte Microsoft die Suche von einer Linkliste hin zu einer multimodalen Answer Engine. Der integrierte Microsoft Copilot (basierend auf GPT-4 und GPT-5 Technologien) liefert direkte Antworten, generiert Bilder und analysiert komplexe Dokumente in Echtzeit.

Marktanteile 2026: In Deutschland erreicht Bing am Desktop Anteile von ca. 15-18 %, getrieben durch die Vorinstallation in Unternehmensnetzwerken und die steigende Beliebtheit von KI-gestützten Features.

Baidu - Chinas Suchmaschine mit KI-Fokus

Baidu wurde 2000 von Robin Li und Eric Xu gegründet und ist die führende Suchmaschine in China. Heute ist Baidu vor allem ein KI-getriebener Technologieanbieter.

1. Sprach- und Marktanpassung

Baidu ist stark auf die chinesische Sprache und das lokale Internet ausgerichtet. Eigene Algorithmen verbinden Semantik mit regulatorischen Anforderungen - ein klarer Vorteil im chinesischen Markt.

2. Plattform- und KI-Fokus

Neben der Suche betreibt Baidu ein breites Ökosystem (Maps, Baike, Cloud, KI-Modelle).

Strategie: enge Verzahnung von Suche und KI - ähnlich wie Google, aber stärker kontrolliert.

3. Dominanz im lokalen Markt

Baidu profitiert von einem regulierten Umfeld, in dem internationale Anbieter wie Google nur eingeschränkt präsent sind. Gleichzeitig steigt der Wettbewerb durch andere Plattformen.

Yandex - Russische Suchmaschine mit eigenem Ökosystem

Yandex wurde 1997 von Arkady Volozh und Ilya Segalovich gegründet und ist die führende Suchmaschine im russischsprachigen Raum. Das Unternehmen entwickelte sich von einer spezialisierten Suche zu einem umfassenden digitalen Ökosystem.

1. Sprachfokus als Grundlage

Yandex setzte früh auf die Analyse komplexer Sprachstrukturen (Morphologie). Dadurch liefert die Suchmaschine besonders präzise Ergebnisse für russischsprachige Inhalte - ein klarer Vorteil gegenüber internationalen Anbietern.

2. Vom Suchdienst zur Plattform

Im Laufe der Zeit entstand ein breites Ökosystem mit Diensten wie Mail, Maps, Market oder Browser.

Die Strategie: nicht nur Suche, sondern eine integrierte digitale Umgebung - vergleichbar mit Google oder Baidu.

3. Lokale Stärke

Yandex dominiert den russischen Markt vor allem durch Sprachkompetenz, regionale Anpassung und Nutzerverständnis. Gleichzeitig beeinflussen politische und regulatorische Faktoren die weitere Entwicklung.

Yahoo! - Vom Internetpionier zum globalen Webportal

Yahoo! wurde 1994 von Jerry Yang und David Filo (Stanford University) gegründet. Als einer der wichtigsten Wegbereiter des frühen World Wide Web prägte Yahoo das Konzept des Webportals.

1. Die Ära des Webverzeichnisses (1990er Jahre)

Ursprünglich unter dem Namen „Jerry and David’s Guide to the World Wide Web“ gestartet, war Yahoo ein manuell gepflegtes Verzeichnis. Anders als moderne Algorithmen ordneten Redakteure Webseiten thematisch ein, um Struktur in das wachsende Internet zu bringen.

- Zentrale Dienste: Yahoo Mail, Yahoo News und Yahoo Finance machten die Plattform zum weltweiten Startpunkt für Millionen Nutzer.

- Technologie-Ansatz: Yahoo setzte lange auf externe Suchtechnologien (u. a. zeitweise von Google), statt einen eigenen Kern-Algorithmus zu priorisieren.

2. Marktentwicklung und Transformation

In der Dotcom-Boom-Phase war Yahoo eines der wertvollsten Unternehmen weltweit. Mit dem Aufstieg von Google Ende der 1990er Jahre begann jedoch ein schleichender Bedeutungsverlust im Suchsegment.

- Gründe für den Rückgang: Eine zu starke Fokussierung auf Portal-Inhalte (Media-Company-Ansatz) gegenüber der reinen Suchtechnologie sowie strategische Fehlentscheidungen bei Übernahmen.

- Sonderrolle Yahoo! Japan: Während Yahoo global Marktanteile verlor, entwickelte sich Yahoo! Japan zu einer eigenständigen Erfolgsgeschichte und hält 2026 weiterhin eine dominante Stellung im asiatischen Markt (ca. 10 % Marktanteil).

3. Datenschutz und Sicherheit

Als datengetriebenes Portal sammelt Yahoo umfangreiche Nutzerprofile zur Werbepersonalisierung. In der Vergangenheit stand das Unternehmen aufgrund massiver Sicherheitsvorfälle (Datenleaks) in den 2010er Jahren im Fokus der Kritik, was zu einer Verschärfung der heutigen Sicherheitsstandards führte.

Personalisierte Suche: Effizienz versus Neutralität

Moderne Suchmaschinen wie Google, Bing und Yahoo arbeiten überwiegend personalisiert, um die Relevanz der Ergebnisse zu steigern. Diese Anpassung basiert auf individuellen Nutzerprofilen, die durch Logins, Cookies und die Verarbeitung personenbezogener Daten (z. B. Standort und Suchhistorie) erstellt werden.

Vorteile der Personalisierung

Nutzer gelangen häufig schneller zu passgenauen Ergebnissen. Wiederkehrende Themen, bevorzugte Informationsquellen und lokale Bezüge werden automatisch priorisiert. Die Suche wirkt dadurch effizienter und intuitiver.

Die Kehrseite: Verlust der Neutralität

Die Personalisierung schränkt die Objektivität ein. Suchergebnisse sind nicht mehr neutral, sondern spiegeln die Präferenzen des Nutzers wider. Während Google die Zustimmung oft implizit durch tägliche Nutzung voraussetzt, blenden Dienste wie Yahoo bei Erstbesuch oder längerer Abwesenheit explizite Hinweise zur Datenerhebung und zu den Cookie-Richtlinien ein.

Bedeutung der personalisierten Suche für Websitebetreiber

Für Betreiber von Webseiten ist die personalisierte Suche ein zweischneidiges Schwert. Sie bietet einerseits effiziente Analyse-Features, birgt andererseits aber das Risiko einer verzerrten Wahrnehmung der eigenen Performance.

Vorteile: Schnelle Insights direkt in den SERPs

Wer im eigenen Google-Konto angemeldet ist, profitiert von einer direkten Integration von Daten aus der Google Search Console. In den Suchergebnissen (SERPs) erscheinen teilweise exklusive Einblicke in Klickzahlen, Impressionen und Optimierungspotenziale der eigenen Unterseiten. Dies ermöglicht schnelle Ad-hoc-Analysen ohne Plattformwechsel.

Risiken: Die "Ranking-Illusion"

Die personalisierte Suche liefert keinen objektiven Maßstab für die tatsächliche Sichtbarkeit. Da Algorithmen bevorzugte Quellen (die eigene Seite) oben ausspielen, entsprechen die gesehenen Rankings oft nicht der Realität eines neutralen Nutzers.

📢 Fundierte Bewertungen der Auffindbarkeit erfordern immer einen Abgleich zwischen personalisierten Ergebnissen und einer neutralen Baseline (z. B. via Inkognito-Modus oder SEO-Tools).

Personalisierung aus Sicht von Websitebetreibern: Zwischen Nutzwert und Datenverzerrung

Ein Nebeneffekt der Personalisierung ist die Zunahme standortbezogener und interessenbasierter Anzeigen. Diese hohe Werbedichte kann die organischen Ergebnisse verdrängen. Als Lösung dienen hier diskrete Suchmaschinen, die auf Nutzertracking verzichten und eine werbeärmere Umgebung bieten.

Was sind diskrete Suchmaschinen? (Privacy Search)

Diskrete (oder anonyme) Suchmaschinen sind spezialisierte Suchwerkzeuge, die den Schutz der Privatsphäre und die digitale Anonymität ihrer Nutzer priorisieren. Im Jahr 2026 gelten sie als die wichtigste Alternative zu herkömmlichen Anbietern, da sie den Zugriff auf unzensierte und neutrale Informationen ermöglichen, ohne Nutzerprofile zu erstellen.

Zentrale Datenschutz-Funktionen für maximale Anonymität

Um die Privatsphäre zu gewährleisten, setzen diskrete Suchmaschinen auf ein Bündel technischer Maßnahmen:

- Verzicht auf Suchhistorien: Im Gegensatz zu Google oder Bing werden Suchanfragen nicht gespeichert. Dies verhindert den Aufbau von Datenbanken über Nutzerinteressen.

- Verschlüsselte Kommunikation (HTTPS): Durch durchgehende SSL/TLS-Verschlüsselung wird der Datentransfer vor dem Zugriff Dritter geschützt.

- IP-Anonymisierung: Viele Anbieter verschleiern die IP-Adresse des Nutzers, sodass Anfragen nicht zum individuellen Endgerät zurückverfolgt werden können.

- Anti-Tracking-Technologien: Diskrete Suchmaschinen unterbinden das websiteübergreifende Tracking. Es werden keine Profile für gezielte Werbe-Retargeting-Maßnahmen erstellt.

Prävention von Filterblasen: Durch den Verzicht auf Personalisierung erhalten alle Nutzer identische Ergebnisse. Dies verhindert die algorithmische Einengung der Informationsvielfalt.

💡Wenn du tiefer in die Vielfalt der Anbieter eintauchen möchtest, bietet unsere Suchmaschinen-Datenbank einen Überblick über aktuell mehr als 200 gelistete Dienste.

Vergleich diskreter Suchmaschinen: geschätzter Marktanteil und Hauptquelle der Suchergebnisse

| Suchmaschine | Geschätzter Marktanteil | Einordnung | Hauptquelle der Suchergebnisse |

|---|---|---|---|

| DuckDuckGo | ca. 0,7-1 % | größte Privacy-Suchmaschine weltweit | Bing + eigener Index |

| Brave Search | ca. 0,2-0,3 % | wachsender eigener Suchindex | eigener Index |

| Startpage | <0,1 % | anonymisierte Google-Ergebnisse | |

| Ecosia | <0,1 % | nachhaltigkeitsorientierte Suche | Bing |

| Qwant | <0,1 % | europäische Privacy-Suche | Bing + eigener Index |

| Swisscows | <0,1 % | semantische Suche aus der Schweiz | externe Suchindizes |

| MetaGer | <0,1 % | deutsche Meta-Suchmaschine | mehrere Suchmaschinen |

| Mojeek | <0,05 % | unabhängiger eigener Suchindex | eigener Index |

| Gibiru | <0,05 % | anonymisierte Suche aus den USA | externe Suchindizes |

| SearXNG | <0,05 % | dezentrale Open-Source-Metasuche | mehrere Suchquellen |

Einordnung der Privacy-Search-Landschaft

Die Marktstruktur der diskreten Suchmaschinen ist stark konzentriert:

- DuckDuckGo dominiert den Privacy-Search-Markt deutlich.

- Brave Search wächst seit Einführung seines eigenen Index schnell.

- Viele kleinere Anbieter bleiben Nischenangebote unter 0,1 % Marktanteil.

Gemeinsam erreichen alle diskreten Suchmaschinen zusammen nur etwa 1-2 % des weltweiten Suchmarktes.

Anonyme Suchmaschinen

Duckduckgo

DuckDuckGo ist eine datenschutzorientierte Suchmaschine aus den USA, die seit 2008 betrieben wird und weltweit zu den bekanntesten Alternativen zu klassischen Suchmaschinen zählt. DuckDuckGo kombiniert Ergebnisse aus verschiedenen Quellen und verzichtet bewusst auf die Erstellung persönlicher Nutzerprofile.

Besonderheiten von DuckDuckGo:

- keine Speicherung von IP-Adressen oder Suchhistorien

- keine personalisierte Ergebnisdarstellung

- Kombination aus eigenem Crawler, Bing-Index und weiteren Datenquellen

- integrierte Datenschutzfunktionen wie Tracking-Blocker und verschlüsselte Verbindungen

DuckDuckGo liefert für alle Nutzer weitgehend identische Suchergebnisse, unabhängig von Standort oder Suchverhalten. Die anonyme Suchmaschine richtet sich an Nutzer, die eine vertraute Sucherfahrung ohne Profilbildung wünschen. Für Website-Betreiber ist DuckDuckGo SEO-relevant, da ein großer Teil der Suchergebnisse auf dem Bing-Index basiert und somit Bing-Rankings indirekt Einfluss auf die Sichtbarkeit haben. Die Rankings basieren stärker auf klassischer Relevanz, technischer Sauberkeit und Content-Qualität, nicht auf Personalisierung.

Startpage

Startpage ist eine datenschutzfreundliche Suchmaschine mit Sitz in Europa, die sich auf anonyme Websuche spezialisiert hat. Sie bezeichnet sich selbst die sicherste Suchmaschine, denn Startpage kombiniert die Suchergebnisse von Google mit einem konsequenten Schutz der Privatsphäre der Nutzer.

Besonderheiten von Startpage:

- keine Speicherung von IP-Adressen oder Suchverläufen

- keine Nutzerprofile, kein Tracking

- Google-Suchergebnisse ohne direkte Datenweitergabe an Google

- integrierter „Anonymous View“, um Suchergebnisse anonym aufzurufen

Startpage richtet sich vor allem an Nutzer, die hochwertige Suchergebnisse wünschen, ohne persönliche Daten preiszugeben. Für Website-Betreiber ist Startpage SEO-seitig relevant, da die Rankings auf dem Google-Index basieren, jedoch ohne personalisierte Ausspielung.

Swisscows

Swisscows ist eine datenschutzorientierte Suchmaschine mit Sitz in der Schweiz, die besonderen Wert auf Privatsphäre, Sicherheit und familienfreundliche Inhalte legt. Nutzer werden nicht getrackt, Suchanfragen nicht gespeichert.

Besonderheiten von Swisscows:

- vollständiger Verzicht auf Nutzertracking und Profilbildung

- Serverstandort Schweiz mit hohen Datenschutzstandards

- automatische Filterung nicht jugendfreier Inhalte

- Nutzung externer Suchindizes (u. a. Bing) in Kombination mit eigener semantischer Analyse

Swisscows positioniert sich bewusst als ethische Alternative zu großen Suchmaschinen. Für Website-Betreiber ist Swisscows SEO-relevant, da die Rankings primär auf klassischer OnPage-Optimierung, technischer Sauberkeit und inhaltlicher Klarheit basieren - ohne personalisierte Verzerrung der Suchergebnisse.

MetaGer

MetaGer ist eine datenschutzfreundliche Meta-Suchmaschine aus Deutschland, die von einem gemeinnützigen Träger betrieben wird. MetaGer kombiniert Suchergebnisse aus verschiedenen Suchmaschinen, ohne Nutzer zu tracken oder personenbezogene Daten zu speichern.

Besonderheiten von MetaGer:

- vollständiger Verzicht auf Tracking und Nutzerprofile

- Serverstandort Deutschland, Betrieb durch einen eingetragenen Verein

- Zusammenführung mehrerer Suchindizes (Meta-Suche)

- transparente Datenschutzerklärung und Open-Source-nahe Ausrichtung

- optionaler anonymer Zugriff auf Suchergebnisse

MetaGer richtet sich an Nutzer, die Wert auf Datenschutz, Transparenz und Neutralität legen. Für Website-Betreiber ist MetaGer SEO-seitig relevant, da Rankings indirekt von den angebundenen Suchquellen abhängen und vor allem durch technische Sauberkeit, saubere Indexierbarkeit und inhaltliche Relevanz beeinflusst werden.

Qwant

Qwant ist eine europäische Suchmaschine aus Frankreich, die mit dem Ziel entwickelt wurde, eine datenschutzfreundliche Alternative zu US-amerikanischen Suchdiensten zu bieten. Qwant verarbeitet Suchanfragen ohne individuelle Nutzerprofile und unterliegt den europäischen Datenschutzrichtlinien.

Besonderheiten von Qwant:

- kein Tracking von Nutzern oder Erstellung persönlicher Profile

- keine personalisierte Werbung

- europäische Infrastruktur mit DSGVO-Orientierung

- eigene Suchtechnologie kombiniert mit externen Indizes

- separate Bereiche für Web, News, Bilder und soziale Inhalte

Qwant richtet sich an Nutzer, die Wert auf europäische Datenhoheit und Privatsphäre legen. Für Website-Betreiber ist Qwant SEO-relevant, da Rankings teilweise aus eigenen Indizes stammen und teilweise auf externen Suchquellen basieren.

SearXNG

SearXNG ist eine offene Metasuchmaschine, die von einer internationalen Entwicklergemeinschaft gepflegt wird. Sie kombiniert Ergebnisse aus verschiedenen Suchmaschinen und kann auf eigenen Servern betrieben werden.

Besonderheiten von SearXNG:

- Open-Source-Projekt mit transparenter Entwicklung

- keine Speicherung von Suchanfragen oder IP-Adressen

- Zusammenführung mehrerer Suchquellen in einer Anfrage

- selbst hostbare Instanzen möglich

- starke Community rund um Datenschutz und Dezentralisierung

SearXNG richtet sich vor allem an technisch versierte Nutzer und Organisationen, die eine vollständig kontrollierbare Suchlösung nutzen möchten. Für Website-Betreiber hängt die Sichtbarkeit stark von den angebundenen Suchmaschinen ab.

Für Website-Betreiber ist die Suchmaschine SEO-seitig kaum relevant, da die Sichtbarkeit von den jeweils angebundenen Suchmaschinen abhängt und nicht von einem eigenen Ranking-Algorithmus.

Interessant finde ich, dass bei SearxNG der Quellcode frei verfügbar ist. Das unterstreicht die Transparenz des Projekts. Searx arbeitet mit sogenannten Instanzen. Das bedeutet, dass es aktuell etwa 64 verschiedene gehostete Suchmaschinen gibt, die auf der Searx-Engine basieren. Hier findest du eine Liste der Domains.

Brave Search

Brave Search ist eine Suchmaschine des Browserherstellers Brave und wurde mit dem Ziel entwickelt, eine unabhängige und datenschutzfreundliche Websuche bereitzustellen. Die Suchmaschine basiert überwiegend auf einem eigenen Index.

Besonderheiten von Brave Search:

- eigener Suchindex und eigener Webcrawler

- kein Tracking oder Aufbau von Nutzerprofilen

- transparente Rankingfaktoren durch Community-Projekte

- Integration in den Brave Browser

- optionale Nutzung von Community-Signalen für Rankingbewertungen

Brave Search richtet sich an Nutzer, die eine moderne Suchmaschine mit hohem Datenschutzstandard und eigenem Index nutzen möchten. Für Website-Betreiber ist Brave Search zunehmend relevant, da Rankings stark auf technische Zugänglichkeit und Contentqualität basieren.

Ecosia

Ecosia ist eine Suchmaschine aus Deutschland, die sich auf Nachhaltigkeit und Umweltschutz fokussiert. Die Einnahmen aus Suchanzeigen werden größtenteils für weltweite Aufforstungsprojekte verwendet.

Besonderheiten von Ecosia:

- Großteil der Einnahmen wird in Baumpflanzprojekte investiert

- kein Verkauf von Suchdaten an Werbenetzwerke

- Serverbetrieb mit erneuerbarer Energie

- Suchergebnisse basieren größtenteils auf dem Bing-Index

- transparente Finanzberichte zur Mittelverwendung

Ecosia richtet sich an Nutzer, die ihre Internetnutzung mit einem ökologischen Beitrag verbinden möchten. Für Website-Betreiber ist Ecosia SEO-relevant, da Rankings größtenteils mit dem Bing-Index korrelieren.

YaCy

YaCy ist eine dezentrale Suchmaschine, die als Peer-to-Peer-Netzwerk funktioniert. Jeder Nutzer kann selbst einen Teil des Suchindex betreiben und damit zur Infrastruktur beitragen.

Besonderheiten von YaCy:

- dezentrale Architektur ohne zentrale Server

- Peer-to-Peer-Suchindex über viele Nutzer verteilt

- Open-Source-Software

- kein Tracking und keine zentrale Datensammlung

- selbst betreibbare Suchknoten

YaCy richtet sich an Nutzer und Organisationen, die eine vollständig dezentrale Suchinfrastruktur unterstützen möchten. Für Website-Betreiber ist YaCy SEO-seitig schwer vorhersehbar, da der Index durch das Netzwerk der Teilnehmer aufgebaut wird.

Gibiru

Gibiru ist eine datenschutzorientierte Suchmaschine aus den USA, die sich als nicht zensierte Alternative zu großen Suchplattformen positioniert. Sie kombiniert anonyme Suche mit zusätzlichen Sicherheitsfunktionen.

Besonderheiten von Gibiru:

- keine Speicherung von Suchanfragen oder IP-Adressen

- keine personalisierte Ergebnisfilterung

- integrierte Funktionen für anonymes Browsing

- Alternative Darstellung von Suchergebnissen ohne Profilfilter

- Fokus auf freie und ungefilterte Informationssuche

Gibiru richtet sich an Nutzer, die eine möglichst ungefilterte Suche ohne Tracking wünschen. Für Website-Betreiber hängt die Sichtbarkeit größtenteils von den zugrunde liegenden Suchindizes ab, die von externen Quellen beeinflusst werden.

Diskrete Suchmaschinen zur SEO-Analyse

Die Notwendigkeit neutraler Suchergebnisse

Um die tatsächliche Performance einer Website zu bewerten, ist eine neutrale Baseline unerlässlich. Herkömmliche Suchanfragen werden durch Personalisierungsparameter wie den Browserverlauf, Cookies und den geografischen Standort verzerrt. Für eine objektive Wettbewerbsanalyse müssen daher Tools oder Methoden genutzt werden, die diese Faktoren isolieren, um die „echte“ Platzierung in den SERPs (Search Engine Result Pages) abzubilden.

Warum die normale Suche trügerisch ist

Suchmaschinen wie Google nutzen Personalisierung, um die Relevanz zu steigern. Das bedeutet, die Ergebnisse werden basierend auf verschiedenen Faktoren angepasst:

- Suchhistorie: Wenn du oft auf deine eigene Seite klickst, merkt sich Google das und spielt sie dir weiter oben aus.

- Standort: Regionale Ergebnisse (Local SEO) variieren stark, je nachdem, ob du in Berlin, München oder Hamburg suchst.

- Gerätetyp: Die Ergebnisse zwischen Desktop und Mobile können sich deutlich unterscheiden.

Strategien für eine „neutrale“ Ranking-Baseline

Um die objektive Sichtbarkeit einer Webseite ohne den Einfluss individueller Filterblasen zu ermitteln, ist eine neutrale Baseline entscheidend. Folgende Methoden haben sich 2026 in der SEO-Praxis bewährt:

- Google Search Console (GSC): Die zuverlässigste Datenquelle. Die GSC liefert die durchschnittliche Position über alle Nutzer-Interaktionen hinweg. Ein GSC-Wert von 4,2 verdeutlicht dabei die Varianz der personalisierten Suche: Er zeigt an, dass man für einen Nutzer auf Platz 3 und für einen anderen auf Platz 6 gelandet ist.

- Professionelle SEO-Suiten (Rank Tracker): Tools wie Sistrix, Semrush oder Ahrefs nutzen neutrale Rechenzentren für ihre Abfragen. Dies gilt als der Goldstandard für eine standortunabhängige Analyse.

- Anonyme Suchmaschinen: Privacy-orientierte Suchdienste bieten eine schnelle Möglichkeit für Ad-hoc-Abfragen ohne vorherige Profilbildung oder Tracking-Historie.

- Inkognito-Modus & Parameter: Das private Fenster unterdrückt zwar die Browser-Historie, berücksichtigt aber weiterhin den Standort (IP-Adresse). Der Parameter

&pws=0gilt mittlerweile als technisch unzuverlässig.

Quellen & Belege

- Google Search Central Google bestätigt offiziell, dass Suchergebnisse auf Basis von Kontext (Standort, Gerät) und früherem Suchverhalten angepasst werden. Die Google Search Console wird daher als primäre Quelle für die „durchschnittliche Position“ empfohlen, da sie aggregierte Nutzerdaten statt Einzelansichten liefert.

- Search Engine Journal (SEJ) Fachartikel betonen regelmäßig, dass der Inkognito-Modus allein nicht ausreicht, um die IP-basierte Standorterkennung zu umgehen. Professionelle Rank-Tracker sind für eine neutrale Baseline notwendig.

- Elandas/Moz: Führende SEO-Software-Anbieter dokumentieren das Phänomen der „Filter Bubble“, bei der wiederholte Besuche der eigenen Seite das Ranking in der eigenen Wahrnehmung künstlich erhöhen.

Was sind Kindersuchmaschinen?

Kinder-Suchmaschinen sind speziell entwickelte Suchmaschinen für Kinder und Jugendliche. Ihr Ziel ist es, sichere, altersgerechte und verständliche Suchergebnisse bereitzustellen. Dabei werden Inhalte gefiltert, die für Kinder ungeeignet sein könnten, etwa Gewalt, Pornografie oder extremistische Inhalte.

Im Unterschied zu klassischen Suchmaschinen arbeiten Kinder-Suchmaschinen meist mit redaktionell geprüften Webseitenlisten, speziellen Inhaltsfiltern und vereinfachten Benutzeroberflächen, damit Kinder Informationen leichter finden und verstehen können.

Merkmale von Kinder-Suchmaschinen

Kinder-Suchmaschinen unterscheiden sich von klassischen Suchmaschinen durch mehrere Eigenschaften:

- Inhaltsfilter: Ungeeignete Inhalte werden automatisch ausgeschlossen.

- Redaktionelle Auswahl: Viele Seiten werden von Pädagogen oder Redaktionen geprüft.

- Einfache Sprache: Suchergebnisse sind oft leichter verständlich aufbereitet.

- Kindgerechtes Design: Große Icons, klare Farben und einfache Navigation.

- Datenschutz: Häufig weniger Tracking oder personalisierte Werbung.

Bedeutung für Medienkompetenz

Kinder-Suchmaschinen spielen eine wichtige Rolle bei der Medienbildung. Sie ermöglichen Kindern einen sicheren Einstieg in die Online-Recherche und helfen dabei, den Umgang mit Informationen im Internet zu lernen.

Da sie Inhalte stärker filtern als klassische Suchmaschinen, bieten sie zwar weniger Ergebnisse, dafür aber eine höhere inhaltliche Sicherheit und Verständlichkeit für junge Nutzer.

Beispiele für Kinder-Suchmaschinen

FragFINN

FragFINN ist eine deutsche Kinder-Suchmaschine, die von einer gemeinnützigen Initiative betrieben wird. Sie richtet sich vor allem an Kinder im Grundschulalter und basiert auf einer sogenannten Whitelist, also einer Liste geprüfter kinderfreundlicher Webseiten.

➡️Besonderheiten:

- geprüfte Webseiten durch Medienpädagogen

- Fokus auf sichere Internetnutzung

- Kooperation mit Schulen und Bildungsinstitutionen

- sehr strenge Inhaltsfilter

Helles Köpfchen

Helles Köpfchen ist ein Wissensportal mit integrierter Suchfunktion für Kinder und Jugendliche. Neben der Suche bietet die Plattform auch Nachrichten, Lexikonartikel und Lerninhalte.

➡️Besonderheiten:

- Wissensportal mit redaktionellen Inhalten

- Nachrichten speziell für Kinder

- Lern- und Bildungsangebote

- kindgerechte Aufbereitung von Themen

Blinde Kuh

Blinde Kuh war eine der ältesten Kinder-Suchmaschinen im deutschsprachigen Raum. Sie wurde speziell für Kinder entwickelt und kombiniert eine Suchfunktion mit redaktionellen Wissensartikeln. Die Blinde Kuh wurde 2024 eingestellt. Grund für das Aus nach über 25 Jahren war das Ende der Förderung durch das Bundesfamilienministerium

KI-Suchmaschinen und Answer Engines - Die neue Generation

In den letzten zwei Jahren hat sich die Websuche grundlegend transformiert. Neben klassischen Linklisten haben sich Answer Engines etabliert. Diese basieren auf Large Language Models (LLMs), die Informationen nicht nur finden, sondern in Echtzeit verarbeiten und synthetisieren.

Funktionsweise: Antworten statt Links (Zero-Click-Search)

Während klassische Suchmaschinen den Nutzer zu einer Webseite führen, fungiert eine Answer Engine oft als Endstation. Man spricht hierbei von der „Zero-Click-Search“, da das Informationsbedürfnis direkt auf der Ergebnisseite gestillt wird. Die KI durchsucht das Web, liest relevante Quellen und generiert daraus einen flüssigen Antworttext.

Wichtige Anbieter und Marktanteile 2026

Der Markt der spezialisierten KI-Plattformen wird derzeit von wenigen Schwergewichten dominiert:

- ChatGPT (OpenAI) - 78,62 % Marktanteil: Der unangefochtene Marktführer kombiniert generative Intelligenz mit Live-Webdaten und verdrängt die klassische Suche in vielen Alltagsbereichen.

- Perplexity AI - 11,89 % Marktanteil: Als reine Answer Engine setzt Perplexity auf einen Chat-Dialog, bei dem jede Behauptung konsequent mit Fußnoten zu den Originalquellen belegt wird.

- Microsoft Copilot - 6,91 % Marktanteil: Durch die tiefe Integration in Windows und den Edge-Browser hat Microsoft die KI-Suche massentauglich gemacht und nutzt die GPT-Technologie für komplexe Aufgaben.

- Google AI Overviews (SGE): Google platziert KI-Zusammenfassungen direkt über den organischen Treffern, um den Spagat zwischen schneller Antwort und Traffic-Erhalt für Publisher zu meistern.

Warum der Hype? Effizienz durch Synthese

Der Hauptvorteil liegt in der Zeitersparnis. Anstatt Informationen aus mehreren Quellen selbst zusammenzufügen, übernimmt die KI die Synthese. Besonders bei „Wie funktioniert...“-Fragen oder direkten Produktvergleichen bieten Answer Engines einen massiven Effizienzvorteil.

Herausforderungen: Verlässlichkeit und Datenschutz

Trotz der technologischen Fortschritte bleiben zwei kritische Punkte bestehen:

- Halluzinationen: KIs können faktisch falsche Antworten generieren. Eine transparente Quellenangabe (wie bei Perplexity) ist daher für den Faktencheck essenziell.

- Datenhunger: Die Personalisierung erfordert enorme Mengen an Nutzerdaten. Wer Anonymität priorisiert, findet in diskreten Suchmaschinen weiterhin die sicherere Alternative.

Direktvergleich: Klassische Suchmaschine versus Answer Engine

| Merkmal | Klassische Suchmaschine | Answer Engine |

|---|---|---|

| Primäres Ziel | Finden von Quellen & Webseiten. | Direktes Beantworten der Frage. |

| Nutzererlebnis | „Hilf mir, die beste Seite zu finden.“ | „Sag mir einfach die Lösung.“ |

| Rolle der Webseite | Die Webseite ist das Ziel des Nutzers. | Die Webseite ist Datenlieferant für die KI. |

| Herausforderung | Werbeüberlastung & SEO-Spam. | Gefahr von erfundenen Fakten (Halluzinationen). |

Überblick der Marktanteile von KI-Plattformen (Stand 2026)

📊Wer dominiert die KI-Antworten?

Betrachtet man ausschließlich spezialisierte KI-Chat-Plattformen und Answer Engines (Stand Anfang 2026), ergibt sich eine klare Rangordnung. Wichtig: Diese Zahlen spiegeln die direkte Nutzung der KI-Tools wider, nicht den gesamten Suchmaschinenmarkt.

| Plattform / Engine | Anteil (KI-Markt) |

|---|---|

| ChatGPT (OpenAI) | 78,62 % |

| Perplexity AI | 11,89 % |

| Microsoft Copilot (Standalone) | 6,91 % |

| Google Gemini (Standalone) | 0,96 % |

| Sonstige (z. B. Claude, You) | 1,62 % |

Hinweis zur Interpretation: Googles tatsächliche KI-Reichweite ist weitaus größer, da die "AI Overviews" direkt integriert sind. Diese Statistik zeigt jedoch die bewusste Wahl spezialisierter KI-Tools.

Bewertung des Marktanteils von Perplexity

Obwohl der Marktanteil von Perplexity gering wirkt, gilt die Plattform 2026 als disruptivste Kraft. Sie transformiert die Suche von der Link-Navigation hin zur direkten Wissensvermittlung durch drei Qualitätsmerkmale:

- Effizienz durch Werbefreiheit: Direkte Antworten ohne gesponserte Anzeigen sparen wertvolle Recherchezeit.

- Validierung durch Quellen: Jede Information wird mit Fußnoten belegt, was das Vertrauen stärkt und Faktenchecks ermöglicht.

- Echtzeit-Indexierung: Die Live-Suche bietet Zugriff auf tagesaktuelle Informationen jenseits starrer Trainingsdaten.

📌Fazit für 2026: Google konkurriert nicht mehr nur mit Linklisten, sondern mit Plattformen, die den Suchvorgang durch sofortige Wissensvermittlung ersetzen. Perplexity besetzt hierbei die lukrative Nische der professionellen Recherche.

Kleines Glossar der KI-Suche: Was steckt dahinter?

Die Suche im Wandel - vom Klick zum Zitat

Die klassische Suchlandschaft verändert sich rasant und damit auch die strategische Ausrichtung für SEOs und Website-Betreiber. Während die klassischen Suchmaschinen immer noch auf Listen mit Linkes setzen, etablieren sich sogenannte Answer Engines wie ChatGPT, Claude oder Perplexity zunehmend als neue Endstation für Nutzeranfragen.

In dieser Ära der Zero-Click-Search reicht es nicht mehr aus, einfach nur in den Suchergebnissen aufzutauchen. Dein Content muss so strukturiert und präzise aufbereitet sein, dass KI-Systeme ihn direkt als Informationsquelle nutzen können.

Entscheidend ist daher, dass deine Inhalte nicht nur gefunden werden, sondern in generierten Antworten als Quelle zitiert und sichtbar hervorgehoben werden.

Genau hier setzt Generative Engine Optimization (GEO) an. Mit der richtigen Struktur, klaren Antworten und einer sauberen Informationsarchitektur erhöhst du die Wahrscheinlichkeit, dass große Sprachmodelle deine Inhalte verstehen, nutzen und referenzieren.

So sicherst du dir Sichtbarkeit in der KI-gestützten Suche der Zukunft - nicht nur als Link, sondern als zitierte Quelle.

➡️Mehr Informationen dazu findest du unter AEO & GEO im Zeitalter von LLMs

Wie hilfreich war dieser Beitrag für dich gewesen?

FAQ: Wissenswertes über Suchmaschinen

Weiterführende Informationen über Suchmaschinen